近日,档案智能开发与服务国家档案局重点实验室研究员、武汉大学信息管理学院王平教授团队在国际先进人工智能协会 AAAI 2024发表题为“N-Gram Unsupervised Compoundation and Feature Injection for Better Symbolic Music Understanding”的AI音乐理解研究领域最新研究成果。AAAI是人工智能领域的国际顶级会议之一,也是中国计算机学会(CCF)分类的A类会议。2023级武汉大学数据科学博士生李佳佳是论文的共同第一作者;王平教授是通讯作者;武汉大学为论文第一完成单位。

传统音乐AI技术多聚焦于音频信号的理解,而此次研究的亮点在于其针对符号化音乐理解的创新方法。这项研究在音乐理解领域引入了N-Gram理论,推出了一种独特的无监督复合词技术(UCW),旨在深化对符号化音乐的理解。并且在模型结构层面推出了NG-Midiformer模型,它融合了N-Gram Transformer编码器的特点,极大地增强了模型对音乐符号的识别和处理能力。

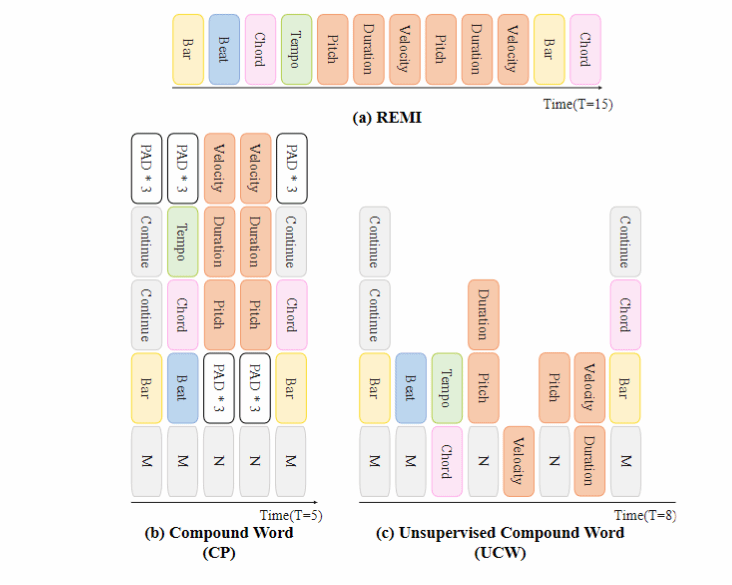

图1 REMI、CP和UCW之间的关系和区别

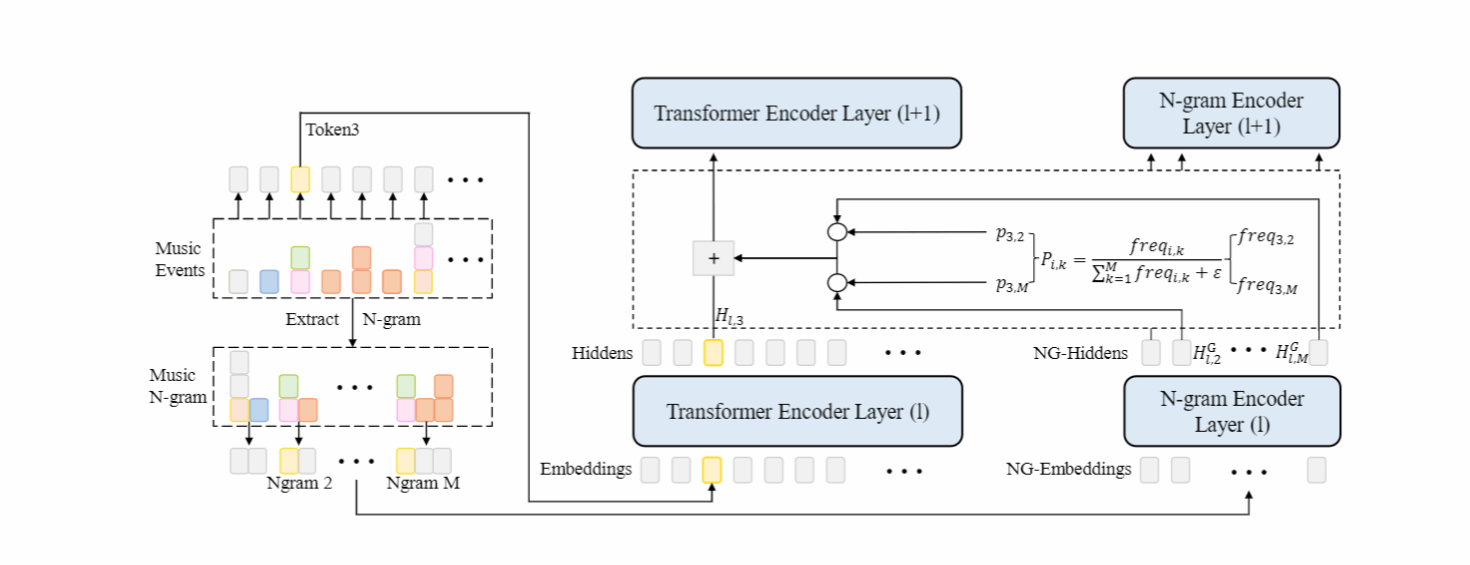

通过应用深度学习和N-Gram技术,NG-Midiformer能够更深入地分析音乐序列,有效地捕捉音乐元素间的微妙联系。此外,本研究还引入了特征注入的方法,将额外的音乐特征信息融入模型中。这些特征可以包括音乐的风格、情感等方面的信息,有助于提高对音乐的理解和生成。通过使用N-Gram无监督复合和特征注入的方法,本研究成功地解决了符号音乐理解和生成中的一些问题。这些方法可以提高对音乐的结构和特征的理解,从而更好地生成符合特定风格和情感的音乐。它在多个公开数据集上表现出色,达到了行业领先的效果。

图2 N-gram Transformer编码器整体架构

该论文为符号音乐理解领域提供了新的研究视角和方法。其结合自然语言处理技术和音乐领域的特殊需求,为AI在音乐理解上的应用创造了新的手段。档案智能开发与服务重点实验室始终致力于将前沿科技转化为推动社会发展的实际力量。期待研究的成果能够为音乐、艺术与科技的融合带来更多可能性,共同开启音乐AI与数据科学结合的新篇章。

该研究获得了国家自然科学基金、湖北省自然科学基金、中央高校基金等项目的资助。